Doutor pegou diagnóstico de terceirização para chatgpt

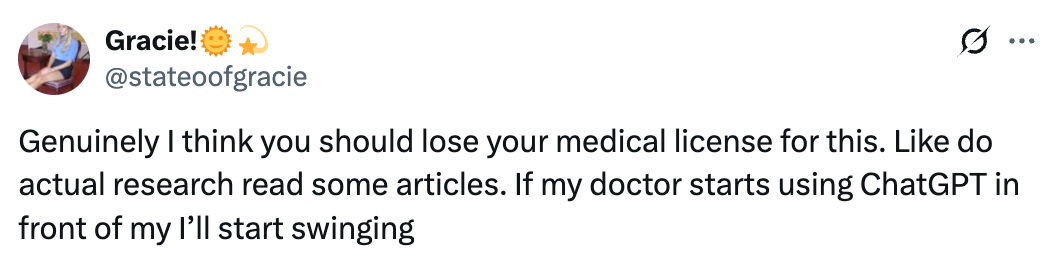

‘Genuinamente, acho que você deve perder sua licença médica para isso.’

![]()

Postado em 9 de maio de 2025 9:30 CDT

O uso do ChatGPT por um médico durante uma visita ao paciente faz com que os usuários de mídia social debatem o futuro do tratamento médico.

Vídeo em destaque

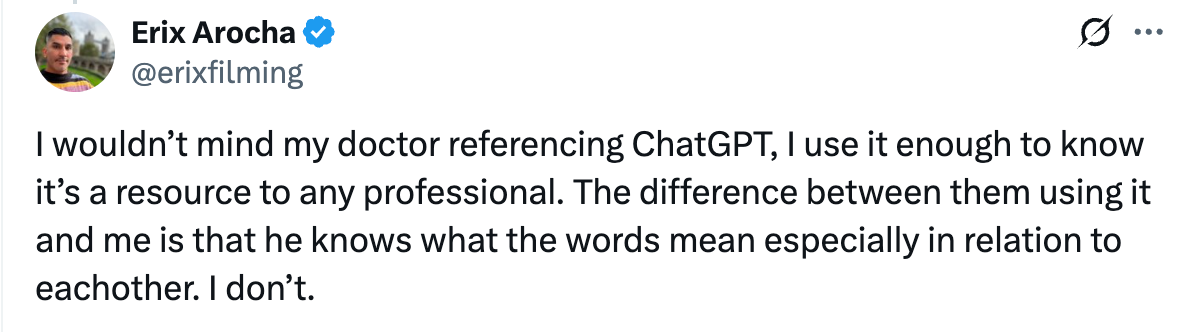

“Levou meu pai ao doutor, ele cortou o dedo com uma faca e o médico estava usando o ChatGPT”, compartilhou Mayank Jain (@Mayankja1n) em X no início de maio. “Com base na história do bate -papo, é para cada paciente.”

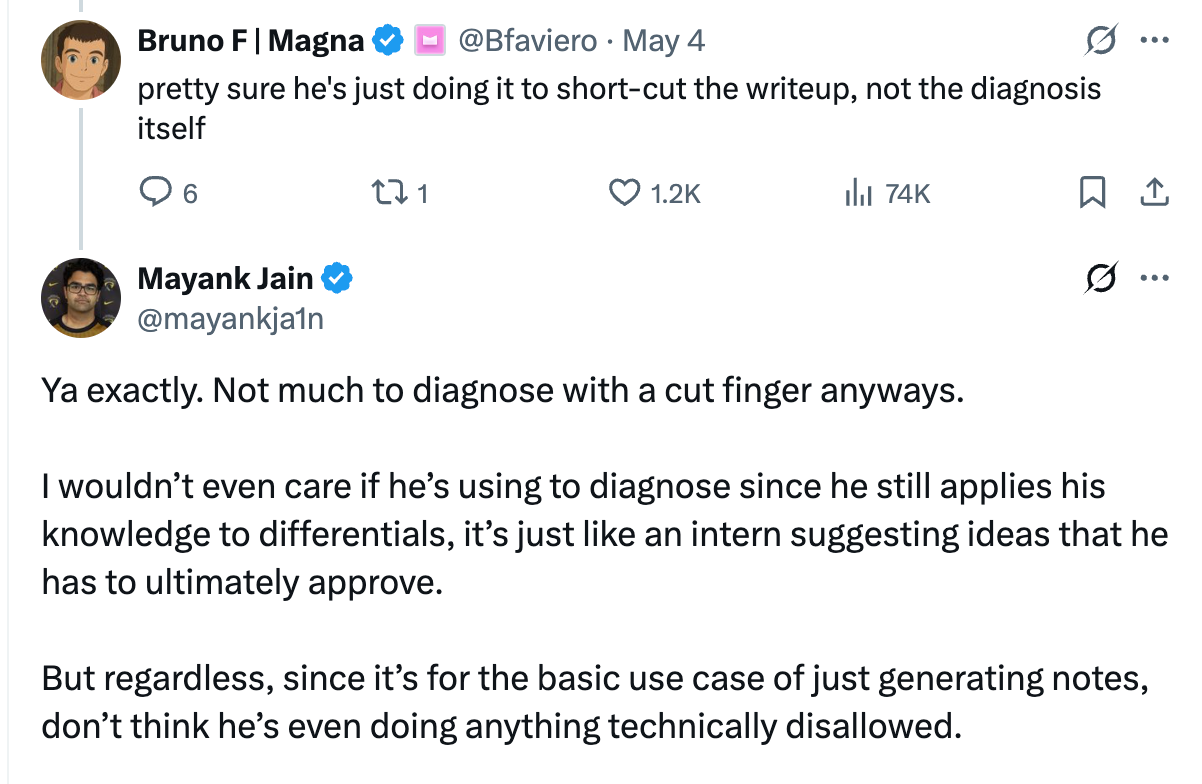

As fotos que ele tirou mostraram que o médico contribuiu com informações básicas – “laceração indicadora esquerda com a referência cirúrgica da faca de cozinha para cuidados e suturas de feridas” – e o ChatGPT cuspiu uma resposta que incluía um histórico de doença atual (HPI), histórico médico, resultados do exame físico e uma avaliação e plano final.

Não está claro se essas informações foram todas baseadas na entrada anterior do médico ou se o ChatGPT estava simplesmente preenchendo os espaços em branco.

A tela também mostrou uma série de bate-papos anteriores que pareciam estar relacionados principalmente a diagnósticos, com um bate-papo relacionado à Bíblia jogado em boa medida.

Os médicos devem usar chatgpt?

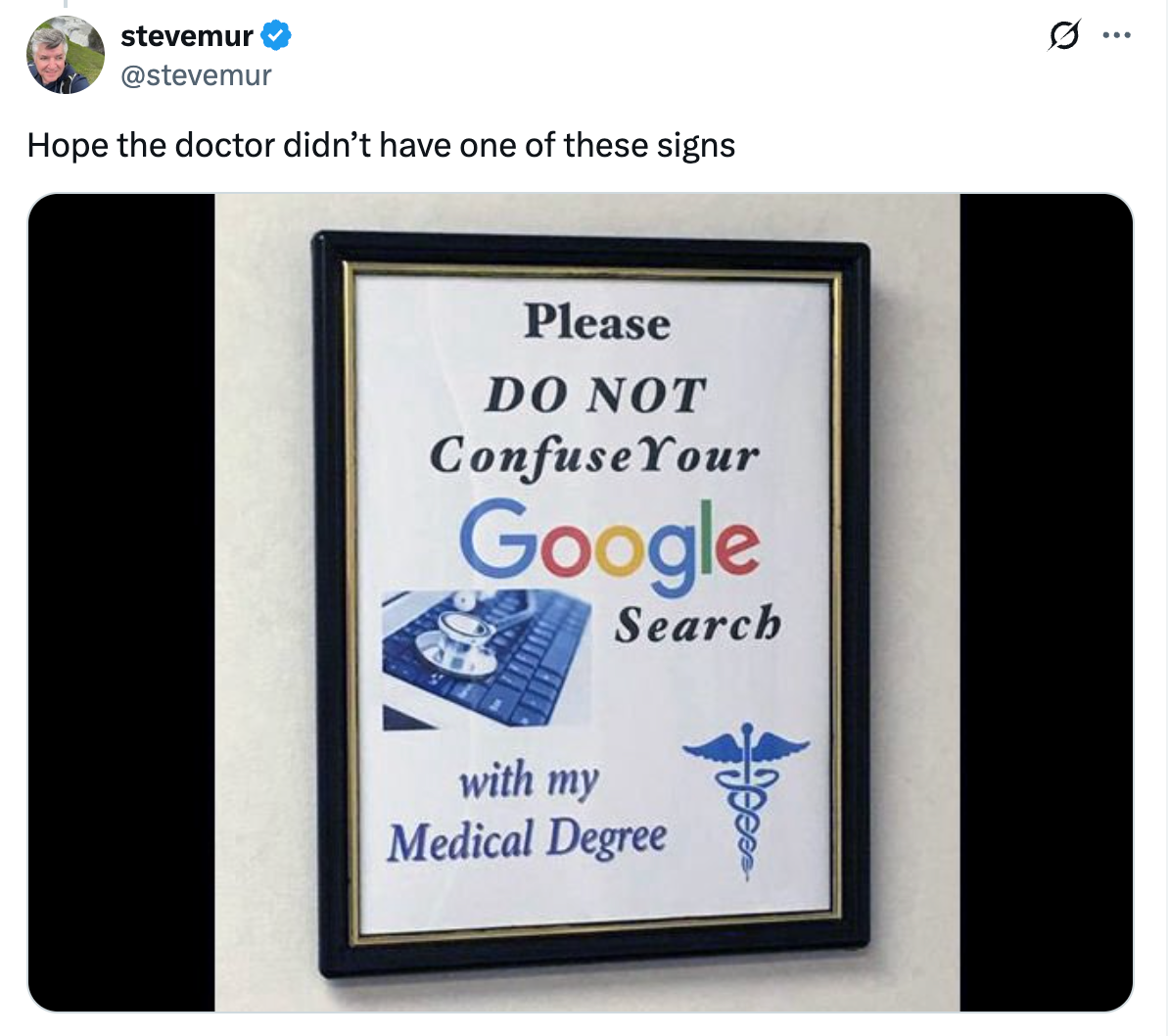

Como todos consideram como a IA pode ser integrada em nossas vidas diárias, a idéia de ser utilizada por profissionais médicos levanta preocupações específicas.

Alguns argumentaram que a IA tem acesso a uma vasta riqueza de conhecimentos muito além do que qualquer pessoa poderia reter por conta própria. Em teoria, isso pode levar a diagnósticos mais rápidos, capturar interações medicamentosas potencialmente perigosas ou ajudar com outros cuidados intensivos.

Também houve a sugestão de que os médicos que usam o ChatGPT e similaram a reduzir tarefas administrativas como preencher gráficos são uma coisa boa, pois isso pode permitir que eles gastassem mais tempo atendendo aos pacientes.

Mas mesmo esse tipo de uso potencialmente levanta preocupações da HIPAA nos Estados Unidos.

“Os médicos podem optar por não ter o OpenAi usar as informações para treinar o ChatGPT”, escreveu Christian Hetrick em um artigo de 2023 para a USC. “Mas, independentemente de você ter optado por fora, você acabou de violar a HIPAA porque os dados deixaram o sistema de saúde”.

Isso não se aplica em todos os cenários. Os médicos consultam IA ou mantendo a identificação de informações do paciente a partir dela podem estar dentro dos limites do que é permitido. Mas, à medida que o mundo muda rapidamente para se tornar mais dependente da IA, é difícil prever quanto dados serão oferecidos a esses sistemas de terceiros, muito menos como será seguro.

Como um dedo cortado não requer profundo conhecimento médico, a maioria das pessoas não estava muito incomodada com essa instância específica do uso da IA, incluindo Jain. No entanto, mesmo a possibilidade de ter que lidar com longas esperas, prêmios de seguro pesados e pagamentos adicionais apenas para fazer um médico cheque com ChatGPT – algo que todos poderíamos fazer em casa – despertaram a frustração.

– Chuck Petras (@chuck_petras) 5 de maio de 2025

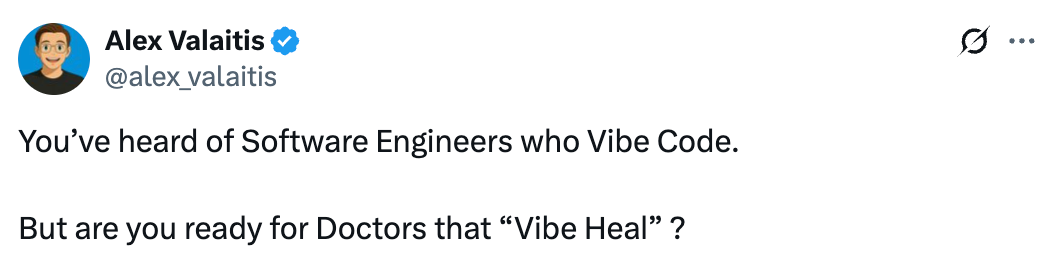

Algumas pessoas acabaram de desistir de fazer mais do que encontrar diversão em todo esse caos e, honestamente, quem pode culpá -las?

Pode não ser o futuro que queríamos, mas talvez seja o futuro que merecemos.

A cultura da Internet é caótica – mas vamos dividi -la para você em um e -mail diário. Inscreva aqui. Você obterá o melhor (e o pior) da Internet direto na sua caixa de entrada.